Learn more about Artificial intelligence - Section 28

通过密度提示链增强GPT-4摘要

近年来,大型语言模型由于其出色的能力而备受关注。大型语言模型可以进行问题回答、内容生成、语言翻译和文本摘要等各种任务...

Amazon SageMaker简化了个人用户的Amazon SageMaker Studio设置

今天,我们很高兴地宣布 Amazon SageMaker 中简化的快速设置体验通过这种新功能,个人用户可以在几分钟内使用默认预设启动 Am...

“AI聊天机器人在不到1美元的时间内快速构建软件”

在一项启迪性的研究中,AI聊天机器人通过经营一个假想的软件公司ChatDev,并在不到七分钟的时间内从零开始开发软件,同时成本...

百度AI研究人员推出VideoGen:一种新的文本到视频生成方法,可以生成高清视频并具有高帧率保真度

文本到图像(T2I)生成系统,例如DALL-E2、Imagen、Cogview、Latent Diffusion等,在近年来取得了长足的进展。另一方面,文本...

如何减轻细粒度图像分类中的背景引起的偏差?屏蔽策略和模型架构的比较研究

细粒度图像分类深入研究了在更广泛的类别中区分密切相关的子类别。例如,不仅仅将图像识别为”鸟”,这种方法可以...

谷歌研究员提出了MEMORY-VQ:一种新的人工智能方法,可以减少存储要求,而不会牺牲存储增强模型的性能

近期语言模型的研究强调了提高事实知识的检索增强的重要性。检索增强涉及为这些模型提供相关的文本段落以提高其性能,但这会...

微软研究员发布PromptTTS 2:通过增强语音可变性和成本效益的提示生成,革新文本转语音技术

由于文本到语音系统的最新发展,合成语音的可懂性和自然度得到了改善。已经为多说话者环境创建了大规模的TTS系统,一些TTS系...

AI模型加速高分辨率计算机视觉

该系统可以提高视频流媒体中的图像质量,或者帮助自动驾驶车辆实时识别道路隐患

LLMs和数据分析:AI如何对大数据进行商业洞察

大型语言模型(LLMs)具有通过广泛的数据集提供有价值的商业洞察的能力。本文探讨了公司如何利用LLMs分析客户评论、社交媒体...

“遇见PhysObjects:一个基于物体的数据集,包含36.9K个众包和417K个自动化的常见家用物品的物理概念标注”

在现实世界中,信息通常通过文本、图片或视频的组合来传达。为了有效地理解和与这些信息互动,人工智能系统必须能够处理两种...

TII的Falcon 180B基础模型现在可以通过Amazon SageMaker JumpStart获得

今天,我们很高兴地宣布,由技术创新研究院(TII)开发的Falcon 180B基础模型现已通过Amazon SageMaker JumpStart提供给客户...

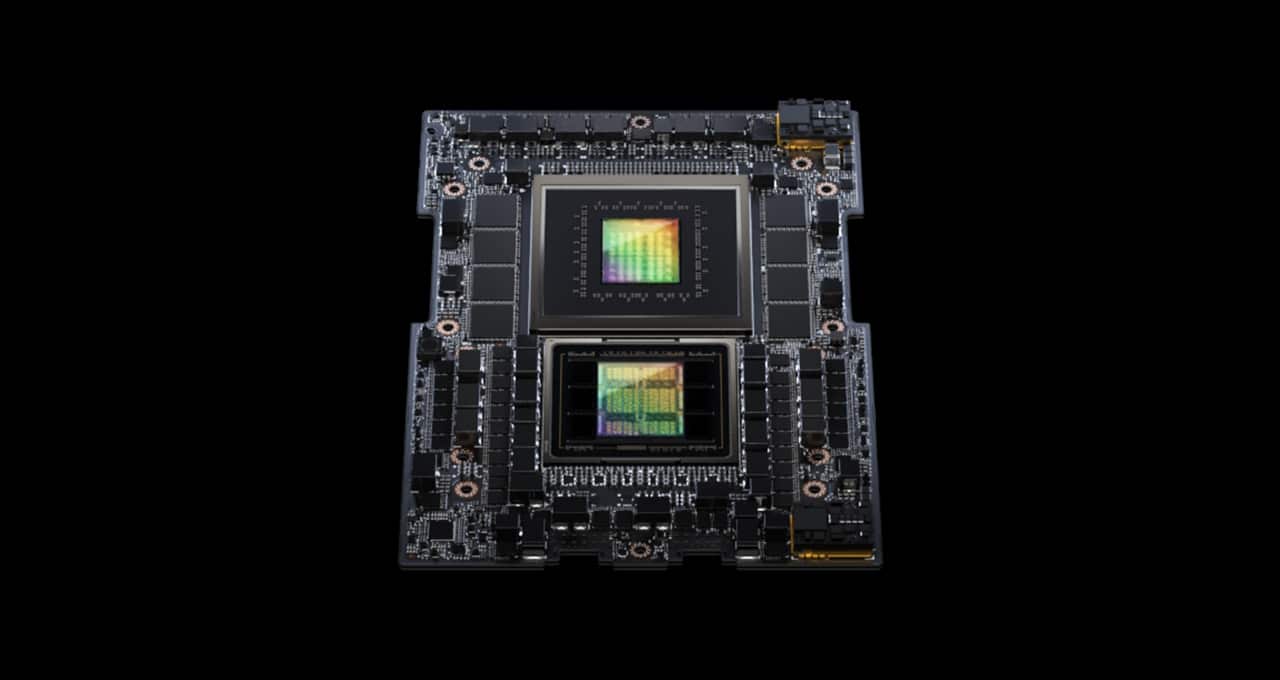

“NVIDIA Grace Hopper超级芯片在MLPerf推理基准测试中占据主导地位”

在MLPerf行业基准测试中,NVIDIA GH200 Grace Hopper Superchip通过了所有数据中心推理测试,扩展了NVIDIA H100 Tensor Core ...

理解Flash-Attention和Flash-Attention-2:扩展语言模型的上下文长度的路径

扩展大型语言模型(LLM)的上下文仍然是扩大使用案例宇宙的最大挑战之一最近几个月,我们看到了Anthropic或OpenAI等供应商...

普林斯顿研究人员提出CoALA:一个概念性人工智能框架,用于系统地理解和构建语言代理

在快速发展的人工智能领域中,开发能够理解和生成人类语言的语言代理人已经成为一个巨大的挑战。这些代理人被期望能够理解和...

认识Verba:一个开源工具,用于构建您自己的RAG检索增强生成流水线并利用LLM进行基于内部的输出

Verba是一个开源项目,旨在为RAG应用提供简化、用户友好的界面。用户可以迅速深入数据,并开始进行相关的对话。 Verba不仅仅...

索尼研究人员提出了BigVSAN:通过GAN-Based Vocoders中的切片对抗网络彻底改变音频质量

神经网络的发展和它们不断增长的受欢迎程度导致了语音合成技术的显著改进。大多数语音合成系统使用两阶段方法:首先,它们从...

“认识ResFields:一种新颖的人工智能方法,克服了时空神经场在有效建模长期和复杂时间信号方面的局限性”

用于表示神经连续时空场的最流行的神经网络架构,也称为神经场,是多层感知器。这是因为它可以对任意维度上的连续信号进行编...

“带我走进时间:SceNeRFlow是一种生成时间一致的NeRF的人工智能方法”

神经辐射场(NeRF)最近在3D领域中成为了一个革命性的概念。它重新塑造了我们处理3D对象可视化的方式,并开启了新的可能性。...

康奈尔大学和特拉维夫大学的研究人员介绍了“Doppelgangers 学习区分相似结构的图像”

请看上面的图片。你能分辨出区别吗?就像区分双胞胎一样。也许其中一个的头发略短一些?还是说他是这样的?在计算机视觉系统...

顶级的GPT和AI内容检测器

GPTZero 教育工作者和其他对识别AI生成的文本感兴趣的人可以使用一个名为GPTZero的工具。GPTZero包括一个剽窃分数,提供了一...

- You may be interested

- 2023年《DevOps 发展状况报告》:关键发现...

- 揭秘深度学习:学生入门神经网络

- 可解释的AI与SHAP

- 使用生成 AI 通过自动电话摘要来提高客服...

- 理解预测维修 —— 波形数据:特征工程(第...

- 使用Nougat模型进行研究论文的生成型人工智能

- DeepMind研究人员通过精确的数学定义重新...

- 利用ChatGPT和人工智能赚钱的三种方式

- RAG的未被揭示的一面:解析其在领域特定搜...

- 在本地CPU上运行小型语言模型的7个步骤

- 这些巧妙的无人机可以在空中锁在一起,形...

- PageRank算法:详细概述

- 神经网络剪枝与组合优化

- 一个简单(但有效)的方法来实现dbt模型的...

- 线性代数3:矢量方程