可解释的AI与SHAP

Interpretable AI and SHAP

解释性人工智能的案例

我们生活在人工智能的时代。它无处不在,媒体也不允许我们忘记它对我们所知的世界所产生的影响。由于人工智能及其应用的日益普及,越来越多的人开始意识到机器学习在日常生活中的作用,从推荐系统到预测,再到生成式人工智能。

随着普通大众对人工智能的敏感性增强,数据科学家和工程师能够在适当的时候解释他们的模型为什么会做出某些预测和决策变得越来越重要。通常,一个好的模型可以接受一个问题,并解释未来可能观察到的情况。然而,这只解决了实际问题的一部分:

“模型还必须解释它是如何得出预测的(为什么),因为正确的预测只能部分解决你最初的问题。” — Christoph Molnar,《可解释机器学习》

上述引述强调了解决模型用于预测的过程的必要性。有许多模型解释方法,但我将关注一种因其效果和简洁性而日益流行的方法。

SHAP(Shapley Additive exPlanations)

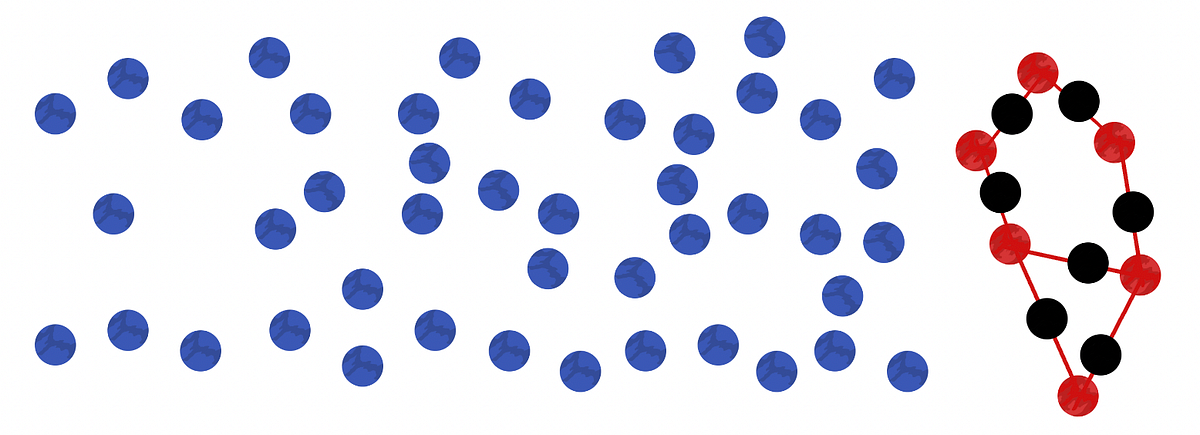

SHAP是Shapley值的应用,Shapley值是合作博弈理论中经过充分测试的概念,用于衡量每个参与者对博弈结果的个人贡献。例如,如果4个朋友一起玩一个合作博弈,可以计算Shapley值来衡量每个朋友对博弈结果的贡献程度。

在可解释机器学习中,SHAP将博弈中的参与者视为模型中的个体特征,并将博弈的结果视为模型的预测。因此,SHAP衡量了模型中每个特征对个体预测的影响。

细节

Shapley值是通过模拟一个缺少某些参与者和存在某些参与者的博弈来计算的。通过模拟不同组参与者存在的各种博弈并计算结果,模型可以…