Learn more about transformers

大规模语言模型:DeBERTa – 带有解编增强注意力的BERT

近年来,BERT已成为许多自然语言处理任务中的头号工具它在处理、理解信息和构建高质量单词嵌入方面表现出色...

大型语言模型,ALBERT-自我监督学习的轻量级BERT

近年来,大型语言模型的发展突飞猛进BERT 成为了最受欢迎和高效的模型之一,能够以高精度解决广泛的自然语言处理任务在...

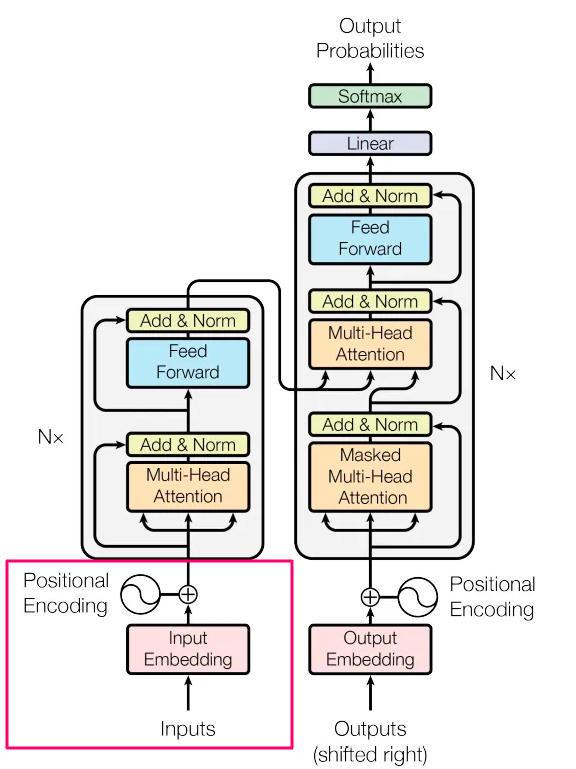

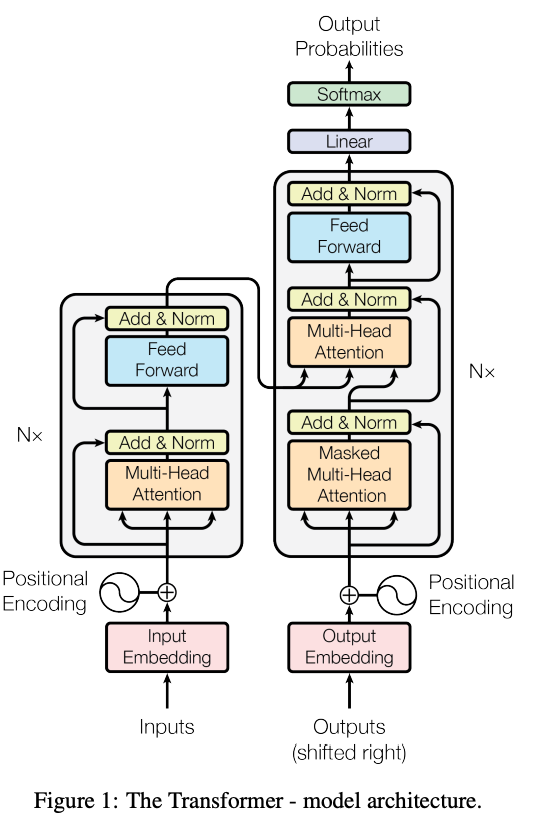

《变形金刚百科全书:你需要了解的一切》

你可能已经听说过变形金刚,并且大家都在谈论它,那为什么还要写一篇新的文章呢?嗯,我是一名研究者,这就要求我对...有非常...

LoRa,QLoRA和QA-LoRA 通过低秩矩阵分解实现大型语言模型的高效适应性

大型语言模型(LLMs)已经开创了一片独特的领域,在理解和生成类似人类文本方面拥有无与伦比的能力LLMs的强大之处可以追溯到...

将文本转换为向量:TSDAE的无监督增强嵌入方法

将在专门领域上进行TSDAE预训练与在通用语料库上进行监督微调相结合,以提高专门领域的嵌入质量嵌入将文本编码为...

洗手盆的注意事项和存储位置:流式 LLM 实现的可视化指南

最近吸引关注的一个人工智能论文之一是一种针对生成式预训练变换器(GPT)模型架构的技术,该技术实现了文本的高效、无限大小的...

DETR(目标检测的变压器)

注意:本文深入探讨了计算机视觉这个复杂领域,特别关注Transformer和注意力机制建议读者先熟悉以下关键概念...

“短文本和图片的连接笔记”

以上论文的作者旨在生成能够在最小或没有监督的情况下用于各种任务的图像良好表示(特征)图像生成的通用特征...

大型语言模型:RoBERTa – 一种鲁棒优化的BERT方法

BERT模型的出现在自然语言处理领域取得了显著的进展BERT的架构源自Transformer,它在各种下游任务上取得了最先进的结果:语言...

变分转换器用于音乐创作:AI能取代音乐家吗?

介绍 在迷人的音乐世界中,创造力无限。从古典交响乐到现代电子节拍,每个音符和旋律都独特地表达了人类的艺术性。但如果我们...

最强大的机器学习模型解析(Transformers, CNNs, RNNs, GANs …)

在2023年,像Transformers、CNNs、RNNs、GANs这样的机器学习模型正在引领人工智能创新在这篇VoAGI文章中探索这些强大的算法

使用Hugging Face Transformers创建BERT嵌入

介绍 Transformer最初是为了将文本从一种语言转换为另一种语言而创建的。BERT对我们研究和处理人类语言的方式产生了很大的影...

简化变压器:使用您理解的词进行最先进的自然语言处理(NLP)-第二部分-输入

龙从蛋中孵化出来,婴儿从腹中出生,AI生成的文本从输入开始我们都必须从某个地方开始 什么样的输入呢?这取决于手头的任务如...

简化Transformer 使用你理解的词语进行最先进的自然语言处理——第1部分——简介

“Transformer 是一种深度学习架构,对于人工智能的进步做出了杰出贡献它是人工智能和技术领域的一个重要阶段,但是…”

《音频机器学习简介》

我目前正在开发一个音频语音识别系统,所以我需要复习一下相关的基础知识这篇文章就是这个目的的结果首先,音频是连续的...

Transformers中的自注意力机制

一个适合初学者的自注意力指南自注意力是“Transformer”的核心,也是当前人工智能领域所有进展的关键驱动因素之一

用Transformer解析爵士和弦

在这篇文章中,我总结了我的研究论文《用基于图的神经解码器预测音乐层次结构》的部分内容,该论文介绍了一种数据驱动的系统...

从原始到精细:数据预处理之旅-第一部分

有时候,我们用于机器学习任务的数据并不适合使用Scikit-Learn或其他机器学习库进行编码因此,我们需要对数据进行处理,以...

现代自然语言处理 详细概述. 第2部分 GPTs

在系列的第一部分中,我们谈到了Transformer如何结束了自然语言处理和理解的序列到序列建模时代在本文中,我们的目标是集中讨...

释放生成式人工智能的潜力:VAEs、GANs和Transformers

介绍 生成式人工智能(Generative AI)是人工智能和创造力交叉领域中的一个令人兴奋的领域,通过使机器能够生成新的原创内容...

- You may be interested

- LLM评估指南:设置和重要的指标

- 使用Hugging Face Optimum将Transformers...

- 2024年使用的前十个实时数据库

- 投机抽样 – 直观且详尽解释

- 将四个人工智能模型相结合,提供终极的沉...

- 开始使用嵌入

- 使用Scikit-Learn管道自动化机器学习模型...

- 麻省理工学院和香港中文大学的研究人员提...

- “女性都去哪儿了?”

- 宣布对Hub进行评估

- 革新图像编辑:介绍Clipdrop的Uncrop——你...

- 《Satya Mallick解决计算机视觉问题》

- Airflow 2.7 现已发布

- 认识 Med-PaLM 多模态(Med-PaLM M):一...

- 使用Zipper快速构建无服务器应用程序:编...