介绍AudioPaLM:谷歌在语言模型方面的突破

在生成式人工智能领域的一项重大发展中,科技巨头谷歌推出了AudioPaLM,一款先进的多模态语言模型。这个开创性的模型结合了谷歌在谷歌I/O 2023上推出的大型语言模型PaLM-2和他们的生成音频模型AudioLM的能力。AudioPaLM建立了一个全面的框架,无缝地集成了文本和口语语言,推动了语言理解和生成的边界。

此外,谷歌还推出了PaLM2来应对GPT-4效应。

多模态语言处理的能力:AudioPaLM

AudioPaLM代表了语言处理的重大进展,因为它结合了基于文本的语言模型和音频模型的优点。它的应用范围非常广泛,包括语音识别和语音到语音的翻译。利用AudioLM的专业知识,AudioPaLM擅长捕捉非语言暗示,如说话人的识别和语调。同时,它整合了嵌入在文本语言模型中的语言知识,如PaLM-2。这种多模态方法使得AudioPaLM能够处理涉及语音和文本的各种任务。

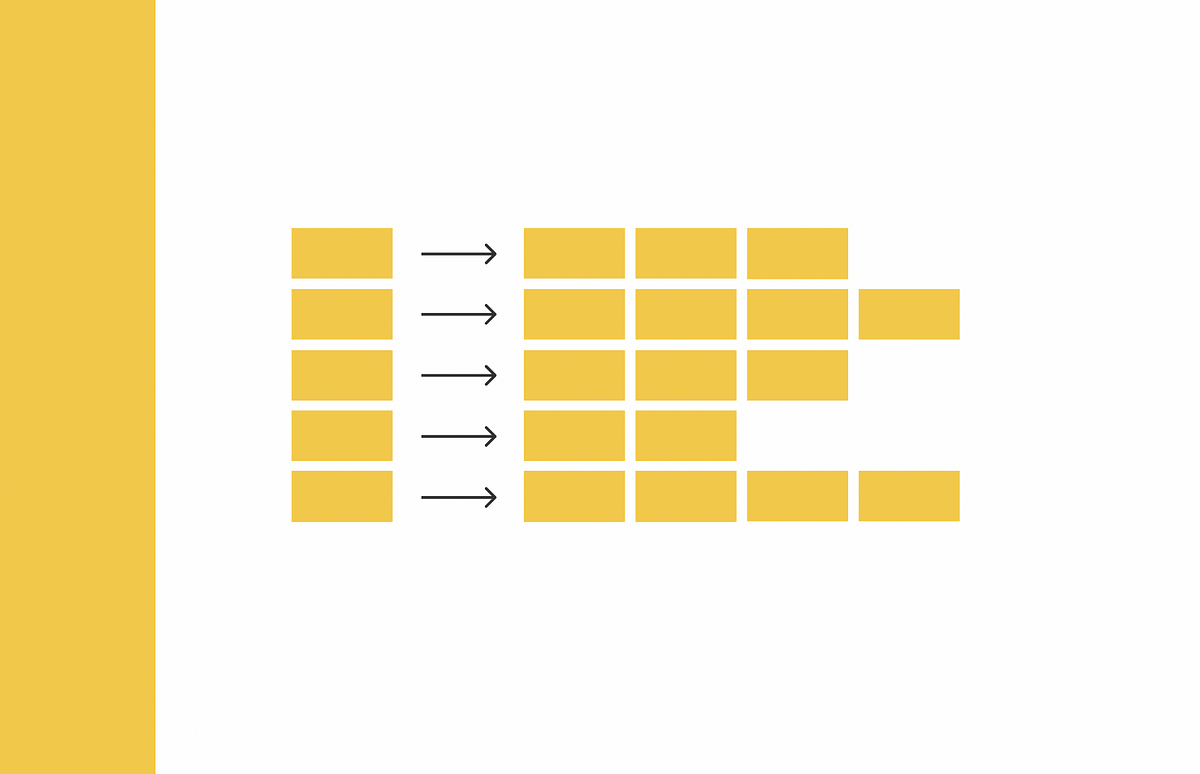

语音和文本的统一架构:AudioPaLM框架

在AudioPaLM的核心是一个强大的大规模转换器模型。AudioPaLM在现有的基于文本的语言模型基础上,通过专门的音频令牌扩展了词汇量。通过训练一个单一的仅解码器模型来处理混合语音和文本任务,AudioPaLM将传统上分离的模型整合成一个统一的架构。这种方法使得该模型在语音识别、文本到语音合成和语音到语音翻译等任务中表现出色,为多模态语言处理提供了一个多才多艺的解决方案。

AudioPaLM的卓越性能和多才多艺

AudioPaLM在语音翻译基准测试中表现出色,展示了其提供准确可靠的翻译的能力。此外,它在语音识别任务中也具有竞争力,可以准确地将口语转换为文本。AudioPaLM可以生成原始语言的转录或提供翻译,也可以根据输入文本生成语音。这种多才多艺的功能使得AudioPaLM成为弥合文本和语音通信差距的强大工具。

谷歌在音频生成方面不断创新

AudioPaLM不是谷歌在音频生成方面的第一次尝试。今年早些时候,他们推出了MusicLM,一款基于高保真度音乐生成模型,根据文本描述创建音乐。MusicLM基于AudioLM的基础构建,利用分层序列到序列的方法生成高质量的音乐。此外,谷歌还推出了MusicCaps,一个为评估文本到音乐生成而设计的策划数据集。

音频生成领域的竞争

谷歌的竞争对手在音频生成领域也在取得重大进展。微软最近推出了Pengi,一款音频语言模型,利用迁移学习在音频和文本任务中表现出色。通过整合音频和文本输入,Pengi可以生成自由形式的文本输出,而无需进行额外的微调。同样,马克·扎克伯格领导的Meta推出了MusicGen,这是一个基于转换器的模型,可以创建与现有旋律相匹配的音乐。Meta的Voicebox是一个多语言生成式人工智能模型,通过上下文学习展示了它执行各种语音生成任务的能力。

我们的观点

谷歌推出AudioPaLM标志着语言模型的又一个里程碑。通过无缝地集成文本和语音,AudioPaLM为各种应用提供了一个强大的工具,从语音识别到翻译。随着生成式人工智能的不断发展,这些多模态语言模型提供了前所未有的能力,让我们更加接近一个文本和语音无缝交互的未来。

图片来源:cloudbooklet