小猪AI - Page 174

Perceiver IO:一种可扩展的、完全注意力模型,适用于任何模态

简介 我们在Transformer中添加了Perceiver IO,这是第一个基于Transformer的神经网络,可以处理各种模态(文本、图像、音频、...

Gradio 正式加入 Hugging Face!

Gradio正在加入Hugging Face!通过收购机器学习初创公司Gradio,Hugging Face将能够为用户、开发人员和数据科学家提供所需的...

使用AutoNLP和Prodigy进行主动学习

机器学习中的主动学习是一个迭代过程,其中您会反复添加已标记的数据,重新训练模型并提供给最终用户。这是一个无穷无尽的过...

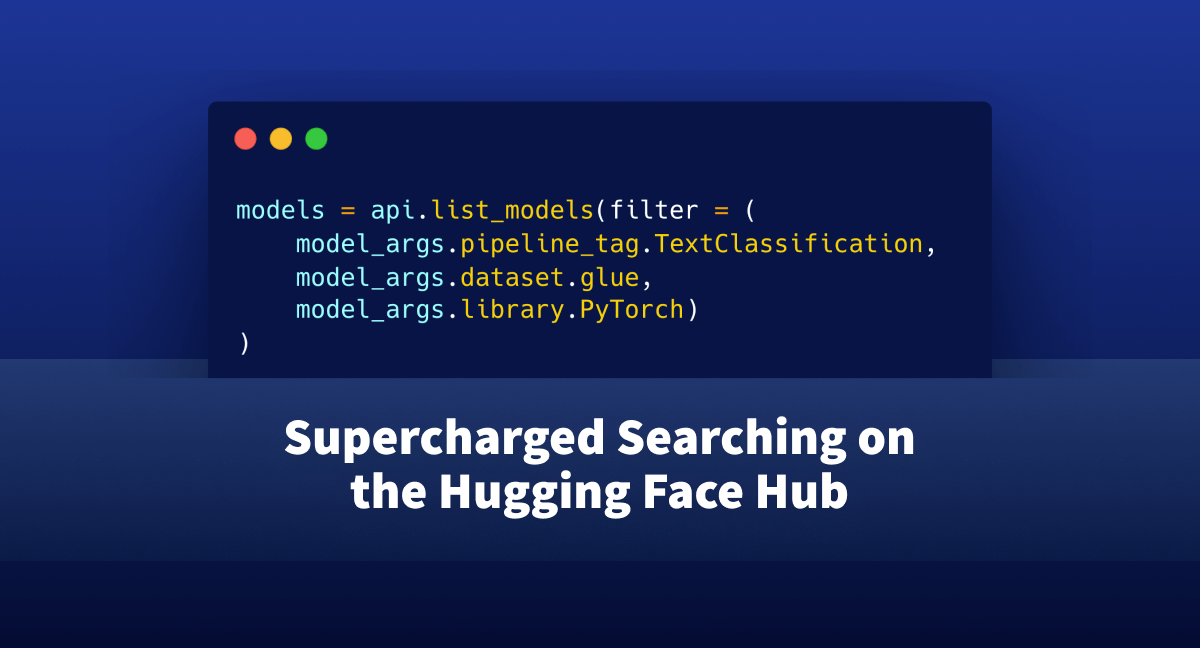

在🤗 Hub上进行超级搜索

huggingface_hub库是一个轻量级接口,提供了一种以编程方式探索Hugging Face提供的托管端点(模型、数据集和Spaces)的方法。...

使用🤗 Transformers中的Wav2Vec2使自动语音识别在大文件上运行

Tl;dr:本文介绍了如何利用连接主义时间分类(CTC)架构的特性,实现在任意长的文件或实时推理过程中实现非常好的质量的自动...

BERT 101 – 解析最先进的NLP模型

BERT 是什么? BERT,全称为双向编码器表示来自 Transformer,是一种用于自然语言处理的机器学习(ML)模型。它由 Google AI ...

在🤗 Transformers中使用受限束搜索引导文本生成

介绍 本博文假设读者熟悉使用不同变种的束搜索进行文本生成的方法,如博文中所解释的:“如何生成文本:使用变种解码方法进行...

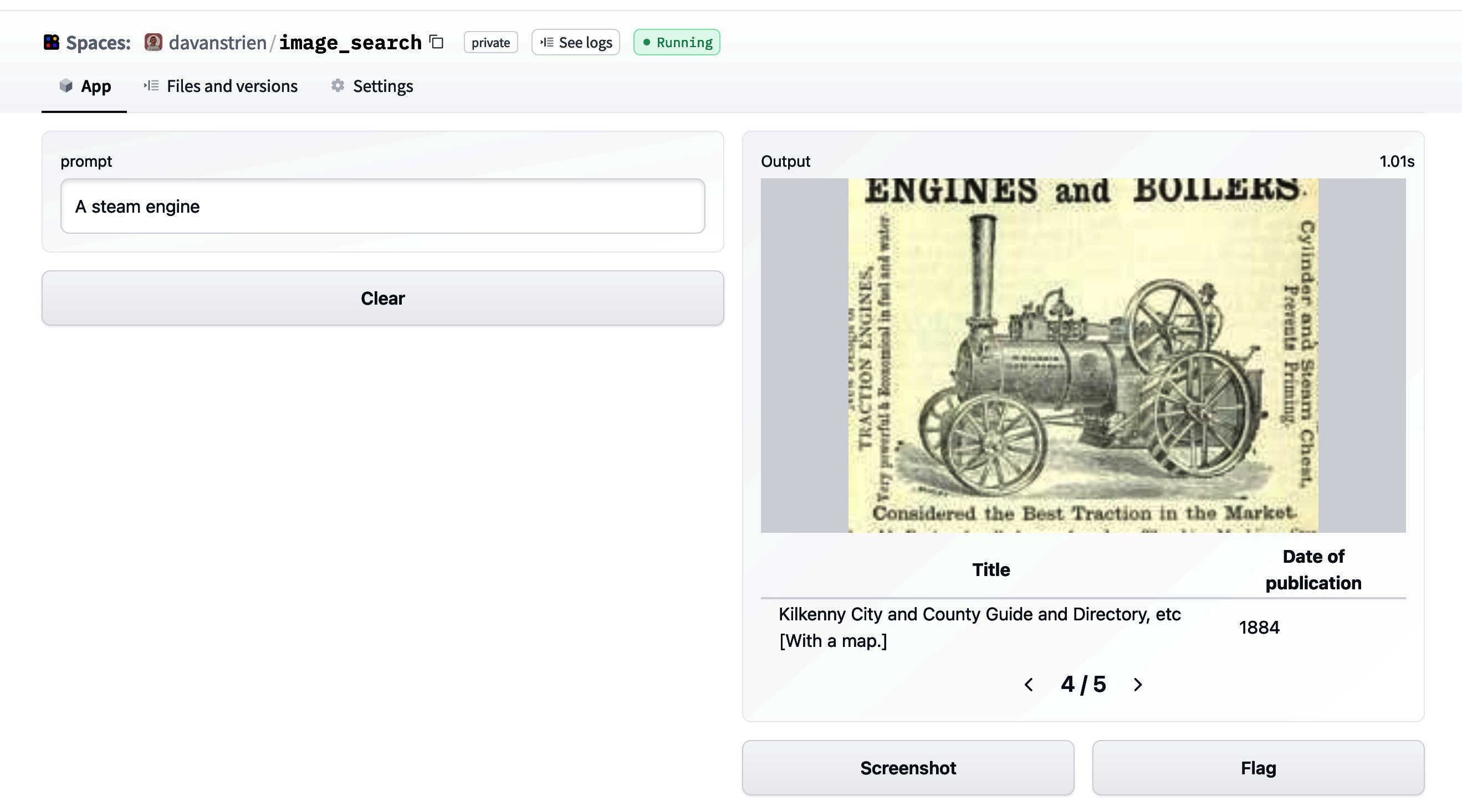

使用🤗数据集进行图像搜索

🤗 datasets 是一个可以轻松访问和共享数据集的库。它还可以高效处理数据,包括处理不适合内存的数据。 当 datasets 最初推出...

使用Hugging Face Transformers和AWS Inferentia加速BERT推理

笔记本:sagemaker/18_inferentia_inference BERT和Transformers的采用继续增长。基于Transformer的模型不仅在自然语言处理领...

使用自定义数据集对语义分割模型进行微调

本指南展示了如何对Segformer进行微调,这是一种最先进的语义分割模型。我们的目标是为披萨送餐机器人构建一个模型,以便它可...

宣布🤗 AI研究住院计划

🤗研究驻地计划是一个为期9个月的机会,可以启动或推进您在机器学习研究方面的职业生涯🚀。驻地的目标是帮助您成长为有影响力...

~不要~重复自己

🤗 Transformers设计哲学 “不要重复自己”或者DRY,是软件开发中众所周知的原则。该原则起源于《实用程序员》(The pragmatic ...

Habana Labs与Hugging Face合作加速Transformer模型训练

加利福尼亚州圣塔克拉拉和旧金山,2022年4月12日 由深度学习驱动的Transformer模型在自然语言处理、计算机视觉、语音等各种机...

机器学习专家 – Lewis Tunstall

🤗 欢迎来到机器学习专家 – Lewis Tunstall 嘿朋友们!欢迎来到机器学习专家。我是你们的主持人Britney Muller,今天的...

CO2排放和🤗 Hub:引领变革

二氧化碳排放是什么,为什么重要? 气候变化是我们面临的最大挑战之一,减少温室气体排放,如二氧化碳(CO2),是解决这个问...

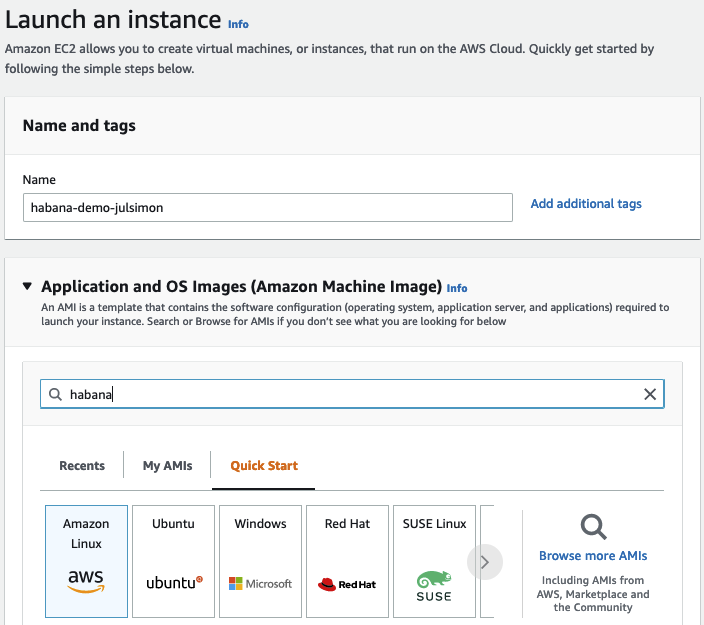

使用Habana Gaudi开始使用Transformers

几周前,我们很高兴地宣布Habana Labs和Hugging Face将合作加速Transformer模型训练。 Habana Gaudi加速器相比最新的基于GPU...

机器学习洞察总监

机器学习领域的主管具备技术技能、问题解决能力和商业眼光,这些技能很少能同时具备。 机器学习和/或数据科学主管通常被要求...

深度强化学习简介

深度强化学习课程第一章 – Hugging Face 🤗 ⚠️ 这篇文章的更新版本在这里 👉 https://huggingface.co/deep-rl-course/u...

学生大使计划的申请现已开放!

作为一个开源公司,Hugging Face相信向全世界不同背景的人们传授开源机器学习的知识是至关重要的。我们的目标是到2023年教授5...

Gradio 3.0 已发布!

机器学习演示 机器学习演示越来越成为发布模型的重要组成部分。演示允许任何人(不仅仅是机器学习工程师)在浏览器中尝试模型...