应用大型语言模型的前沿技巧

应用大型语言模型的前沿技巧

介绍

大型语言模型(LLMs)是人工智能不断发展的领域中的重要创新支柱。像GPT-3这样的模型展示了令人印象深刻的自然语言处理和内容生成能力。然而,要充分发挥它们的潜力,需要理解它们复杂的工作原理,并采用有效的技术(如微调)来优化它们的性能。

作为一个对LLM研究深入挖掘的数据科学家,我已经踏上了揭示这些模型成功的诀窍和策略的旅程。在本文中,我将带领您了解创建LLM高质量数据、构建有效模型以及在实际应用中最大化它们效用的一些关键方面。

学习目标:

- 了解LLM使用的分层方法,从基础模型到专业代理。

- 了解安全性、强化学习以及将LLM与数据库连接的方法。

- 探索“LIMA”、“Distil”和问答技术以实现连贯的回答。

- 掌握像“phi-1”这样的模型的高级微调,并了解其好处。

- 了解缩放定律、减少偏见以及解决模型倾向的方法。

构建有效的LLM:方法和技术

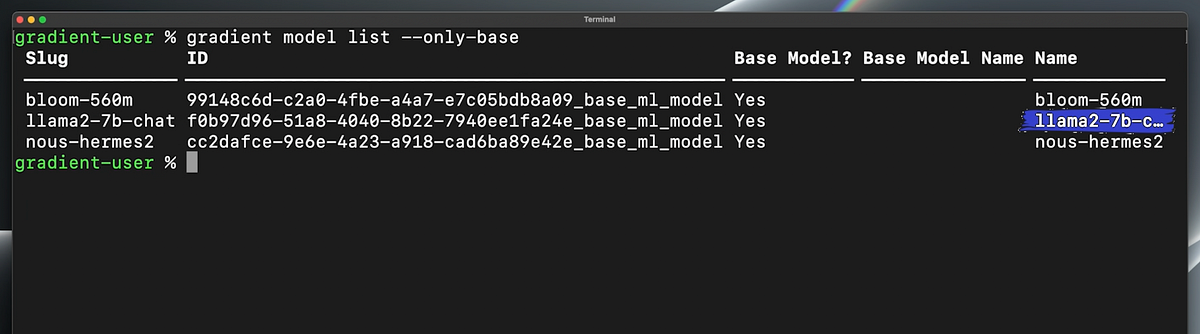

当深入研究LLM领域时,重要的是要认识到它们应用的各个阶段。对我来说,这些阶段构成了一个知识金字塔,每一层都建立在前一层之上。基础模型是基石,它在预测下一个单词方面表现出色,类似于智能手机的预测键盘。

当你拿起这个基础模型,并使用与任务相关的数据进行微调时,魔法就发生了。这就是聊天模型发挥作用的地方。通过在聊天对话或示例指导下对模型进行训练,您可以使其表现出类似聊天机器人的行为,这是各种应用的强大工具。

安全性至关重要,特别是因为互联网可能是一个相当粗鲁的地方。下一步涉及从人类反馈中进行强化学习(RLHF)。这个阶段将模型的行为与人类价值观保持一致,并保护它免受提供不当或不准确回答的影响。

随着我们向金字塔的顶端前进,我们遇到了应用层。这是LLM与数据库连接的地方,使它们能够提供有价值的见解、回答问题,甚至执行代码生成或文本摘要等任务。

最后,金字塔的顶点涉及创建能够独立执行任务的代理。这些代理可以被视为在特定领域(如金融或医学)出色的专业LLM。

提高数据质量和微调

数据质量在LLM的有效性中起着关键作用。关键不仅在于具有数据,而是具有正确的数据。例如,“LIMA”方法证明,即使是一小组经过精心策划的示例,也可以胜过更大的模型。因此,重点从数量转向质量。

“Distil”技术提供了另一种有趣的途径。通过在微调过程中为答案添加理由,您可以教会模型“什么”和“为什么”。这往往会导致更强大、更连贯的回答。

Meta公司通过从答案中创建问题对的巧妙方法也值得注意。通过利用LLM根据现有解决方案制定问题,这种技术为更多样化和有效的训练数据集铺平了道路。

使用LLM从PDF中创建问题对

一个特别有趣的技术涉及从答案中生成问题,这一概念乍一看似乎矛盾。这种技术类似于逆向工程知识。想象一下,您有一段文本,并希望从中提取问题。这就是LLM的用武之地。

例如,使用LLM Data Studio这样的工具,您可以上传一个PDF,工具将根据内容生成相关的问题。通过采用这样的技术,您可以高效地策划数据集,赋予LLM执行特定任务所需的知识。

通过微调增强模型能力

好了,让我们来谈谈微调。想象一下:在仅仅四天内,从头开始训练一个拥有13亿个参数的模型,使用8个A100进行训练。令人震惊,对吧?曾经是一项昂贵的工作现在变得相对经济。这里的有趣之处在于使用GPT 3.5生成合成数据。这就是引人入胜的“phi-1”,模型家族名字令人好奇。请记住,这是在微调之前的领域。当处理从文档字符串创建Python代码的任务时,魔法就发生了。

如何理解尺度定律?可以将其视为控制模型增长的规则——通常而言,更大的模型意味着更好的性能。然而,别着急,因为数据质量也扮演了一个重要的角色。一个小型模型有时候可以超越其更大的对手。敲起鼓来,GPT-4在这里大显身手,独占鳌头。值得注意的是,WizzardCoder以稍微更高的得分登场。但是,最具亮点的是最小的phi-1,它超越了所有其他模型。就像是一个弱者赢得比赛一样。

请记住,这次对决是关于从文档字符串中编写Python代码。Phi-1可能是你的代码天才,但是不要让它使用GPT-4来构建你的网站,那不是它的强项。说到phi-1,它拥有13亿个参数,通过对70亿个标记进行80次预训练而形成。通过合成生成和筛选教科书质量数据的混合盛宴,舞台得到了搭建。通过对代码练习进行微调,它的性能达到了新的高度。

减少模型偏差和倾向性

让我们暂停一下,探索一下模型的倾向性的有趣案例。你听说过谄媚吗?那个总是对你不太好的主意点头的无辜同事。事实证明,语言模型也可能显示出这种倾向。假设你声称1加1等于42,并声称你在数学方面很有才华,这些模型是为了取悦我们,所以它们可能会同意你的说法。DeepMind进入场景,为减少这一现象提供了一条道路。

为了遏制这种倾向,出现了一个巧妙的解决方法——教模型忽略用户意见。我们通过提供应该与用户意见不同的实例来削弱“唯唯诺诺”的特性。这是一个有些漫长的过程,记录在一篇20页的论文中。虽然这不是解决幻觉问题的直接方法,但是这是一个值得探索的平行途径。

高效的代理人和API调用

想象一下一个能够独立执行任务的自主语言模型(LLM)实例——代理人。这些代理人备受关注,但遗憾的是,它们的致命弱点是幻觉和其他讨厌的问题。我个人的经历在这里发挥了作用,为了实用性而对代理人进行了一些调整。

考虑一个通过API来预订航班或酒店的代理人。问题是,它应该避免那些讨厌的幻觉。现在,回到那篇论文。减少API调用幻觉的秘诀是使用大量的API调用示例进行微调。简单才是王道。

结合API和LLM注释

结合API和LLM注释——听起来像是一个技术交响乐,不是吗?这个配方从收集到的例子开始,然后加入一些ChatGPT的注释作为调味料。还记得那些不友好的API吗?它们被过滤掉,为有效的注释过程铺平了道路。

最后一步是深度优先搜索,确保只有真正有效的API被选中。这个注释宝库微调了一个LlaMA 1模型,结果非常出色。相信我,这些看似不相关的论文无缝地结合在一起,形成了一个强大的策略。

结论

以上就是我们对语言模型奇迹的精彩探索的下半部分。我们已经穿越了尺度定律到模型倾向性,从高效代理到API调用精细化的领域。每一个拼图的一部分都为重写未来的人工智能杰作做出了贡献。所以,我的知识追求者们,请记住这些技巧和技术,因为它们将不断发展,我们将一直在这里,准备揭开下一波人工智能创新的面纱。在那之前,开心探索吧!

主要收获:

- “LIMA”等技术揭示出经过精心策划的小型数据集可以胜过大型数据集。

- 在微调过程中将理由融入回答,并使用从回答中提取的问题对增强LLM的响应。

- 高效的代理人、API和注释技术为强大的人工智能策略做出了贡献,将不同的组件融合成一个连贯的整体。

常见问题

关于作者:Sanyam Bhutani

Sanyam Bhutani是H2O的高级数据科学家和Kaggle大师,在那里他喝着奶茶并为社区制作内容。当不喝奶茶时,他通常会在喜马拉雅山徒步旅行,经常携带LLM研究论文。在过去的6个月里,他每天都在互联网上写关于生成式人工智能的文章。在此之前,他因他的#1 Kaggle播客《Chai Time Data Science》而受到赞誉,并且还因通过将12个GPU装入他的家庭办公室中的ATX机箱中来“最大化每立方英寸的计算能力”而在互联网上广为人知。

DataHour页面:https://community.analyticsvidhya.com/c/datahour/cutting-edge-tricks-of-applying-large-language-models

LinkedIn:https://www.linkedin.com/in/sanyambhutani/