Deci AI推出DeciDiffusion 1.0:一个8.2亿参数的文本到图像潜在扩散模型,速度比稳定扩散快3倍

Deci AI发布DeciDiffusion 1.0,一个速度比稳定扩散快3倍的8.2亿参数的文本到图像潜在扩散模型

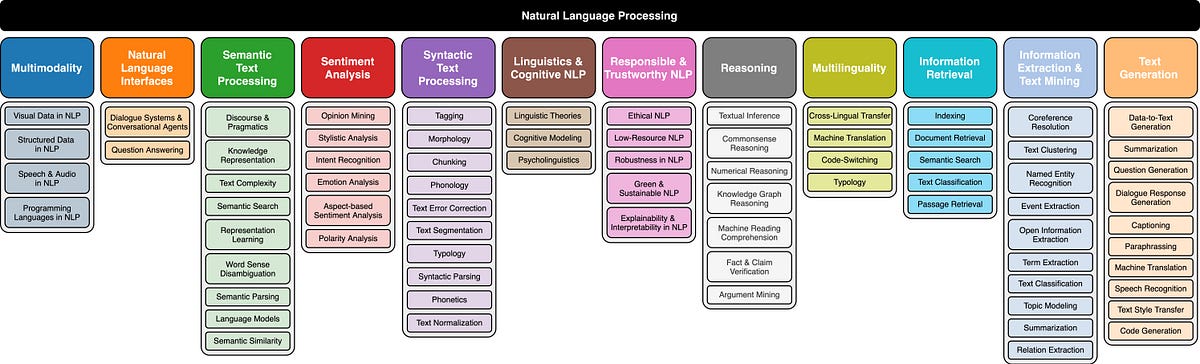

定义问题 文本到图像生成一直是人工智能领域的一个挑战。将文本描述转化为生动、逼真的图像是迈向自然语言理解和视觉内容创作之间的鸿沟的关键一步。研究人员一直在努力解决这个问题,努力开发能够高效、有效地完成这一壮举的模型。

Deci AI引入DeciDiffusion 1.0 – 一种新的方法为了解决文本到图像生成问题,一个研究团队引入了DeciDiffusion 1.0,这是领域中一个重大的飞跃。DeciDiffusion 1.0建立在以前模型的基础上,但引入了几个关键的创新,使其与众不同。

其中一个关键创新是将传统的U-Net架构替换为更高效的U-Net-NAS。这种架构变化减少了参数的数量,同时保持甚至提高了性能。结果是一个不仅能够生成高质量图像,而且在计算方面更加高效的模型。

- 大型语言模型在长篇问答中的表现如何?Salesforce研究人员对LLM的鲁棒性和能力进行了深入探究

- “Hugging Face 是 LLMs 的新 GitHub”

- 使用C优化LLMs,并在您的笔记本电脑上运行GPT、Lama和Whisper

该模型的训练过程也值得注意。它经历了一个四阶段的训练过程,以优化样本效率和计算速度。这种方法对于确保模型能够生成更少迭代次数的图像至关重要,使其在实际应用中更加实用。

DeciDiffusion 1.0 – 更近距离观察深入研究DeciDiffusion 1.0的技术,我们发现它利用了变分自动编码器(VAE)和CLIP的预训练文本编码器。这种组合使模型能够有效地理解文本描述并将其转化为视觉表达。

该模型的一个关键成就是其能够产生高质量的图像。它在可比的Frechet Inception Distance(FID)分数上达到了现有模型的水平,但是所需的迭代次数更少。这意味着DeciDiffusion 1.0具有样本效率高、更快地生成逼真图像的特点。

研究团队进行的用户研究评估DeciDiffusion 1.0的性能是特别有趣的。研究使用一组10个提示,比较了DeciDiffusion 1.0和Stable Diffusion 1.5。每个模型都被配置为生成不同迭代次数的图像,为美学和提示对齐提供了宝贵的见解。

用户研究结果显示,DeciDiffusion 1.0在图像美学方面具有优势。与Stable Diffusion 1.5相比,DeciDiffusion 1.0在30次迭代中一直产生更具视觉吸引力的图像。然而,值得注意的是,提示对齐,也就是生成与提供的文本描述相匹配的图像的能力,在50次迭代时与Stable Diffusion 1.5相当。这表明DeciDiffusion 1.0在效率和质量之间取得了平衡。

总之,DeciDiffusion 1.0是文本到图像生成领域的一项杰出创新。它解决了一个长期存在的问题,并提供了一个有希望的解决方案。通过用U-Net-NAS替换U-Net架构和优化训练过程,研究团队创造了一个不仅能够产生高质量图像,而且更加高效的模型。

用户研究结果强调了该模型的优势,特别是在美学方面的表现。这是使文本到图像生成在各种应用中更易于使用和实用的重要一步。尽管仍然存在一些挑战,如处理非英语提示和解决潜在偏见,但DeciDiffusion 1.0代表了自然语言理解和视觉内容创作融合的一个里程碑。

DeciDiffusion 1.0证明了创新思维和先进训练技术在快速发展的人工智能领域的力量。随着研究人员不断推动AI能够实现的界限,我们可以期待进一步的突破,使文本无缝转化为引人入胜的图像,在各个行业和领域开启新的可能性。