“拟人化人工智能:人类在错误的地方寻找共情”

Anthropomorphized AI Humans seeking empathy in the wrong places

我们是否应该停止竞赛以通过图灵测试?数据质量是否赶上了大语言模型?我们是否天生就善于被欺骗?

对于那些不熟悉“图灵测试”的人来说,它是一种通过人类对机器的测试,以判断机器是否能够表现出和人类一样的智能行为。随着专家们认为人工智能技术现在离达到这个目标只有十几年或几十年的时间,专家和非专家开始对技术是否正在以超出我们社会和人性能够承受的速度发展提出担忧。

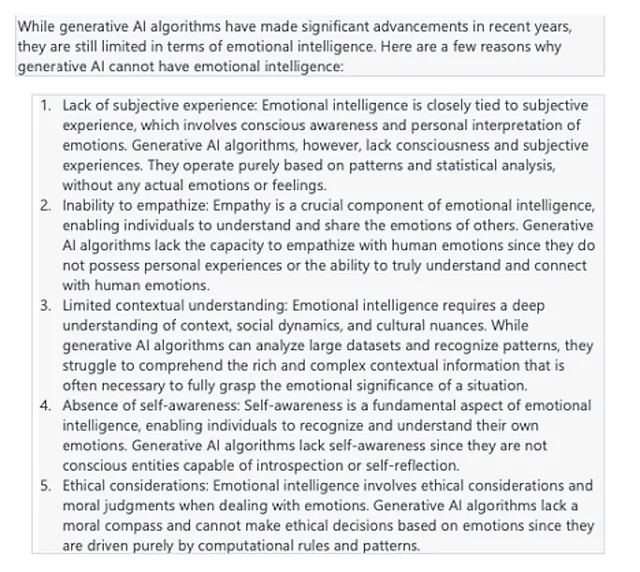

对于某些人来说,智能行为可能意味着语言智能(语言、推理和问题解决),而对于其他人来说,完全的人类智能还包括情绪智能(感知、理解和管理情绪)。强大的“算法智能”或“生成型人工智能”可以模仿语言智能。然而,这些智能机器也会明确告诉你(如果你像我一样问他们)它们没有情绪智能:

几个世纪以来,人们一直给自己的工具取人名,并将人类特征归于无生命的物体。这种行为被称为拟人化。我们给自己的船或汽车取配偶的名字,把游泳池清洁器叫做“大白鲨”,或者地板机器人叫做“吃豆人”。给物体起绰号可以在我们与工具的互动中增添一些乐趣。在这种互动方式中,人们有意识地将工具拟人化,而不是像对待人类一样真正地与物体或工具互动。作为社会动物,我们人类迅速试图确定某人是“朋友还是敌人”,他们在社会等级中的地位,以及他们是否是适合的伴侣。

当技术公司为了改善用户与软件工具的互动而追求用户对工具的“无意识或无思考的拟人化”时,他们会给工具添加人名、人脸图像、对话提示、非正式语言等。作为人类,我们对聊天机器人产生最大的“社交存在感”是当互动不仅仅是文字时…