“相遇InstaFlow:一种新颖的一步生成AI模型,源自开源的稳定扩散(SD)”

InstaFlow A novel one-step generative AI model derived from open-source Stable Diffusion (SD)

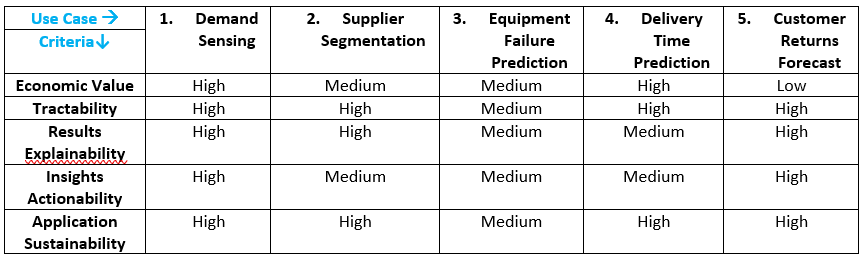

扩散模型在文本到图像生成方面引起了一场革命,提供了卓越的质量和创造力。然而,值得注意的是,它们的多步采样过程因其缓慢而闻名,通常需要多次推断步骤才能达到理想的结果。在本文中,作者介绍了一种创新的一步生成模型,该模型源自开源的稳定扩散(SD)模型。

作者发现,对SD进行简单的蒸馏尝试导致完全失败,原因是一个重要问题:噪声和图像的次优耦合,极大地阻碍了蒸馏过程。为了克服这一挑战,研究人员转向了修正流(Rectified Flow),这是生成模型中的一个最新进展,它结合了概率流的独特技术,称为回流(reflow),逐渐拉直了概率流的轨迹。

这反过来降低了噪声分布和图像分布之间的传输成本。这种耦合的改进极大地促进了蒸馏过程,解决了最初的问题。上面的图像演示了Instaflow的工作原理。

- 这篇来自韩国的人工智能研究介绍了MagiCapture:一种将主题和风格概念进行个性化整合以生成高分辨率肖像图像的方法

- 麻省理工学院学者获得种子资助来探索生成式人工智能的社会影响

- 构建和玩耍!配备LLM的您自己的V&L模型!

通过MS COCO 2017-5k数据集上的FID(Fréchet Inception Distance)得分为23.3,证明了一步扩散式文本到图像生成器的应用,这比以前的最先进技术——渐进式蒸馏(FID 37.2 → 23.3)有了显著的改进。此外,通过使用一个拥有17亿个参数的扩展网络,研究人员进一步提高了FID,达到了22.4的得分。这个一步模型被称为“InstaFlow”。

在MS COCO 2014-30k数据集上,InstaFlow在仅0.09秒的时间内以13.1的FID表现出色,成为≤ 0.1秒类别中表现最好的模型。这超过了最近的StyleGAN-T模型(0.1秒内的FID为13.9)。值得注意的是,InstaFlow的训练仅需199个A100 GPU天的相对较低的计算成本。

基于这些结果,研究人员提出了以下贡献:

- 改进一步SD:2-修正流模型的训练没有完全收敛,仅投入了75.2个A100 GPU天的训练成本。这只是原始SD(6250个A100 GPU天)训练成本的一小部分。通过扩大数据集、模型规模和训练时间,研究人员相信一步SD的性能将得到显著提高。

- 一步ControlNet:通过将我们的流程应用于训练ControlNet模型,可以获得能够在毫秒内生成可控内容的一步ControlNet。

- 个性化的一步模型:通过将SD与扩散模型和LORA的训练目标进行微调,用户可以定制预训练的SD以生成特定的内容和风格。

- 一步生成的神经网络结构:随着使用文本条件的回流和蒸馏创建一步SD模型的进展,出现了几个有趣的方向:

(1) 探索替代的一步结构,例如在GAN中使用的成功架构,可以在质量和效率方面潜在地超越U-Net;

(2) 利用修剪、量化和其他方法构建高效的神经网络的技术,使一步生成更具计算性可承受性,同时最小化潜在的质量降低。