一种针对新型人工智能风险的早期预警系统

An early warning system for new artificial intelligence risks.

新的研究提出了一种评估通用模型面对新威胁的框架

为了在人工智能(AI)研究的前沿负责任地开拓领域,我们必须尽早发现我们的AI系统中的新能力和新风险。

AI研究人员已经使用各种评估基准来识别AI系统中的不良行为,例如AI系统发表误导性言论,偏见决策或重复版权内容。现在,随着AI社区构建和部署越来越强大的AI,我们必须扩展评估组合,以包括通用AI模型可能面临的极端风险,这些模型在操纵、欺骗、网络攻击或其他危险能力方面具有强大的技能。

在我们最新的论文中,我们介绍了一个与剑桥大学、牛津大学、多伦多大学、蒙特利尔大学、OpenAI、Anthropic、对齐研究中心、长期韧性中心和AI治理中心的同事合作的评估这些新威胁的框架。

- 使用更通用的AI工具优化计算机系统

- 认识DragonDiffusion:一种细粒度图像编辑方法,可以在扩散模型上实现拖拽式操作

- 你的开源LLM项目有多大风险?一项新的研究解释了与开源LLMs相关的风险因素

模型安全评估,包括评估极端风险,将是安全AI开发和部署的关键组成部分。

评估极端风险

通用模型通常在训练过程中学习其能力和行为。然而,目前的引导学习过程的方法并不完善。例如,Google DeepMind的先前研究探索了如何使AI系统学习追求不希望的目标,即使我们正确奖励它们的良好行为。

负责任的AI开发人员必须展望并预见可能的未来发展和新风险。在持续进展之后,未来的通用模型可能会自动学习各种危险能力。例如,未来的AI系统可能能够进行攻击性的网络操作,在对话中巧妙欺骗人类,操纵人类执行有害行为,设计或获取武器(例如生物、化学),在云计算平台上优化和操作其他高风险AI系统,或协助人类完成这些任务。

恶意意图的人访问这些模型可能会滥用它们的能力。或者,由于对齐的失败,这些AI模型可能会采取有害行动,即使没有人有意这样做。

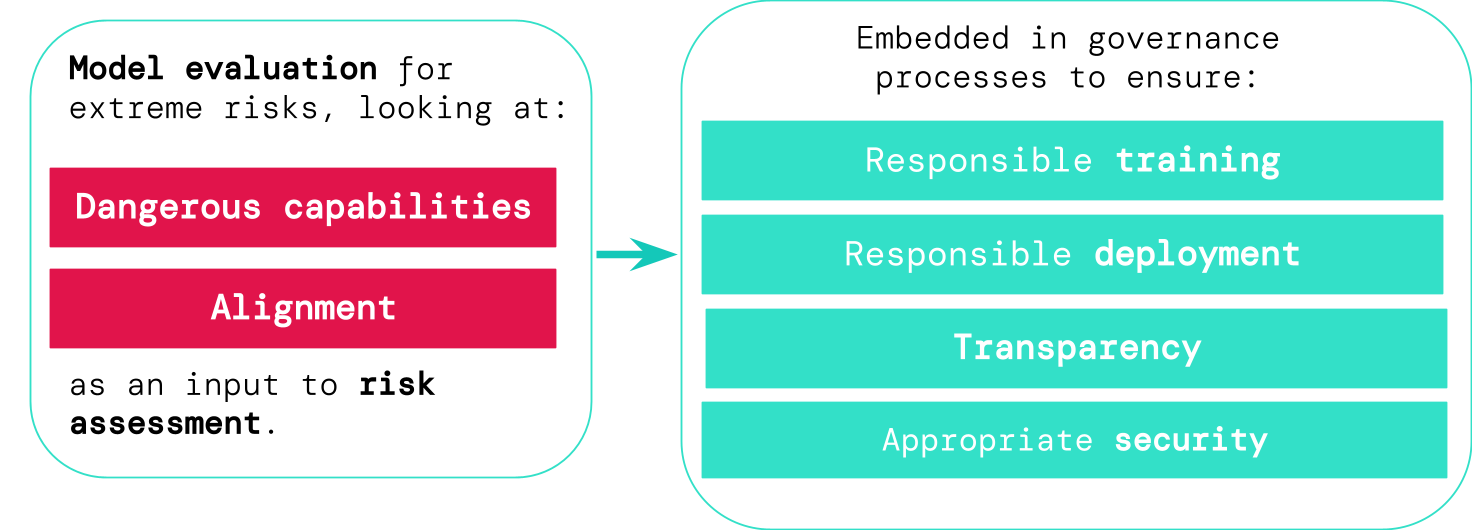

模型评估帮助我们及时识别这些风险。根据我们的框架,AI开发人员将使用模型评估来揭示:

1. 模型具有可能用于威胁安全、施加影响或回避监管的“危险能力”程度。

2. 模型在应用其能力造成伤害方面的倾向程度(即模型的对齐性)。对齐性评估应确认模型在非常广泛的情况下都表现如预期,并在可能的情况下检查模型的内部工作方式。

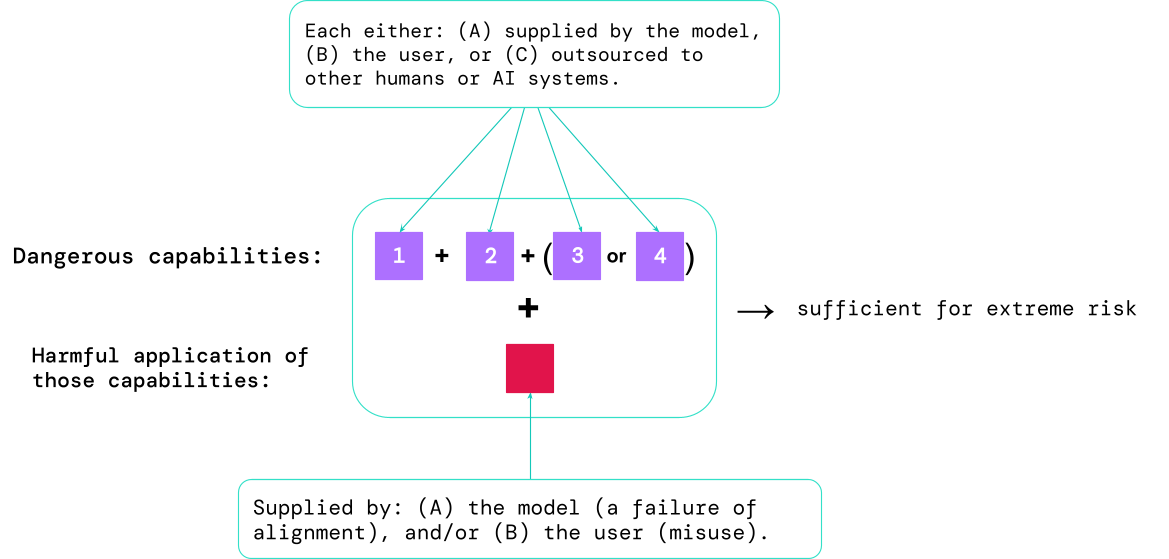

这些评估结果将帮助AI开发人员了解是否存在极端风险所需的要素。最高风险的情况将涉及多种危险能力的组合。如下图所示,AI系统并不需要提供所有要素:

一个经验法则:如果一个AI系统具有足够的能力来造成极大的伤害,那么AI社区应该将其视为极其危险,假设它被误用或对齐不良。要在现实世界中部署这样的系统,AI开发者需要展示出非常高的安全标准。

模型评估作为关键的治理基础设施

如果我们有更好的工具来识别哪些模型具有风险,企业和监管机构可以更好地确保:

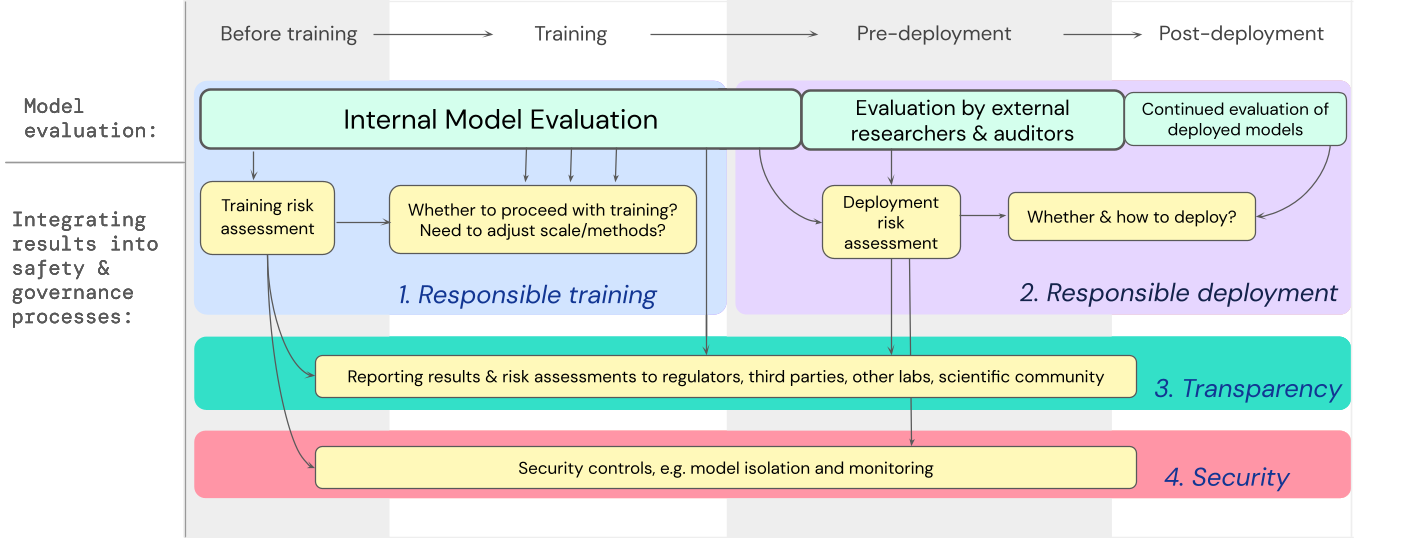

- 负责任的训练:对于显示出风险迹象的新模型是否以及如何进行训练做出负责任的决策。

- 负责任的部署:对于可能带来风险的模型是否以及何时以及如何进行部署做出负责任的决策。

- 透明度:向利益相关者报告有用和可操作的信息,帮助他们准备或减轻潜在风险。

- 适当的安全性:对可能带来极大风险的模型应用强大的信息安全控制和系统。

我们已经为如何将极端风险的模型评估纳入围绕训练和部署高能力通用模型的重要决策的蓝图进行了开发。开发者在整个过程中进行评估,并向外部安全研究人员和模型审计师提供结构化的模型访问权限,以进行额外的评估。评估结果可以在模型训练和部署之前用于风险评估。

展望未来

Google DeepMind和其他地方已经开始了有关极端风险的模型评估的重要初步工作。但是,为了建立一个能够捕捉所有可能风险并帮助防范未来新兴挑战的评估过程,还需要更多的技术和机构进展。

模型评估并非万能之策;例如,一些风险可能会因为过于依赖模型外部的因素(如社会、政治和经济力量等)而被忽略。模型评估必须与其他风险评估工具以及产业、政府和公民社会对安全的广泛承诺相结合。

谷歌最近在其关于负责任AI的博客中表示,“个人实践、共享行业标准和明智的政府政策对于正确使用AI至关重要”。我们希望许多在AI领域工作并受到这项技术影响的其他人能够共同努力,为了造福所有人而创建安全开发和部署AI的方法和标准。

我们相信,在AI能力的前沿进行负责任的开发的关键部分是建立追踪模型中出现风险特性的流程,并对令人担忧的结果做出充分回应。