使用Llama 2进行主题建模

用Llama 2主题建模

使用大型语言模型轻松创建可解释的主题

随着Llama 2的出现,本地运行强大的LLM变得越来越实际。其准确度接近OpenAI的GPT-3.5,非常适用于许多用例。

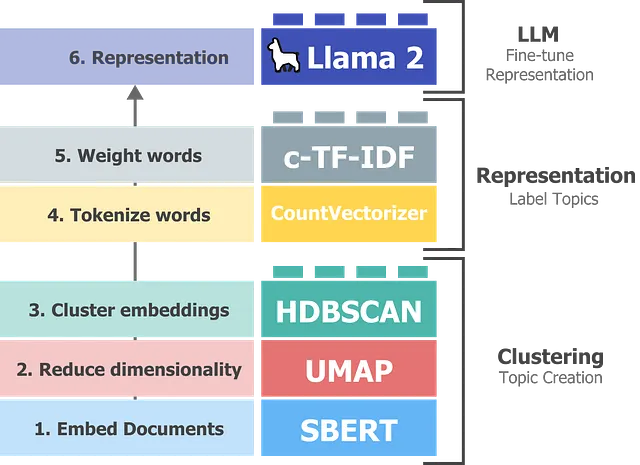

在本文中,我们将探讨如何使用Llama2进行主题建模,而无需将每个文档传递给模型。相反,我们将利用BERTopic,这是一种模块化的主题建模技术,可以使用任何LLM来对主题表示进行微调。

BERTopic的工作方式非常简单。它包括以下5个顺序步骤:

- 嵌入文档

- 降低嵌入的维度

- 聚类降低的嵌入

- 对每个聚类进行文档分词

- 提取每个聚类的最佳表示词

然而,随着Llama 2等LLM的兴起,我们可以比每个主题的一堆独立词语做得更好。直接将所有文档传递给Llama 2并进行分析在计算上是不可行的。我们可以使用向量数据库进行搜索,但我们不确定要搜索哪些主题。

相反,我们将利用BERTopic创建的聚类和主题,让Llama 2对其进行微调和提炼,以得到更准确的信息。

这是BERTopic的主题创建与Llama 2的主题表示的最佳融合。

现在,介绍就到此为止,让我们开始实际操作教程吧!

我们将首先安装一些我们将在本示例中使用的软件包:

pip install bertopic datasets accelerate bitsandbytes xformers adjustText请记住,为了运行此示例,您至少需要一块T4 GPU,这可以……